2020 à 2030 l’enjeu d’une vision 4.0 pour l’Afrique

14 janvier 2020

Algorithmes et plateformes en synergie pour une économie inclusive

25 juin 2020J’ai lu le passionnant livre d’Aurélie Jean sur les algorithmes : De l’autre côté de la machine – Voyage d’une scientifique au pays des algorithmes. C’est un voyage fascinant au coeur des langages informatiques qui dessinent non pas le futur mais bien notre présent. En tant que passionné du numérique et un fervent défenseur des nouvelles technologies et je travaille sur le développement de l’écosystème d’entrepreneurs du numérique en Afrique.

Je suis donc ravi que l’institut Montaigne publie un rapport sur les algorithmes et l’impact des biais. C’est un sujet qui me semble prépondérant. J’ai pu mesurer à quel point l’Institut Montaigne travaille avec professionnalisme et méticulosité lors de ma participation au rapport Energie solaire en Afrique : un avenir rayonnant ?

Algorithmes :

contrôle des biais S.V.P.

Calculer le chemin le plus court sur votre téléphone, constituer automatiquement une playlist avec vos chansons préférées, trouver le résultat le plus pertinent via un moteur de recherche, sélectionner des CV en adéquation avec une offre d’emploi : les algorithmes vous assistent tout le long de la journée. Mais que se passerait-il si un algorithme de recrutement était discriminant ? Qu’il laissait systématiquement de côté les femmes ou des minorités ethniques ? Comment s’assurer que ces erreurs soient mises en lumière et corrigées ?

Nous avons voulu, à travers la quarantaine d’entretiens réalisés, apporter des solutions concrètes pour limiter les dérives potentielles et redonner confiance dans les algorithmes.

Ce rapport tente de donner une perspective française à cette problématique aujourd’hui essentiellement traitée sous un prisme américain. Il poursuit l’étude de Télécom Paris et de la Fondation Abeona, Algorithmes : biais, discrimination et équité publiée en 2019.

Les enjeux des algorithmes

Qu’est-ce qu’un algorithme ?

Un algorithme est une suite d’opérations ou d’instructions permettant d’obtenir un résultat. Une recette de cuisine, par bien des aspects, est un algorithme. Les algorithmes existent sous de nombreuses formes. L’une d’entre elles, l’apprentissage machine (machine learning) a connu un développement significatif ces dernières années.

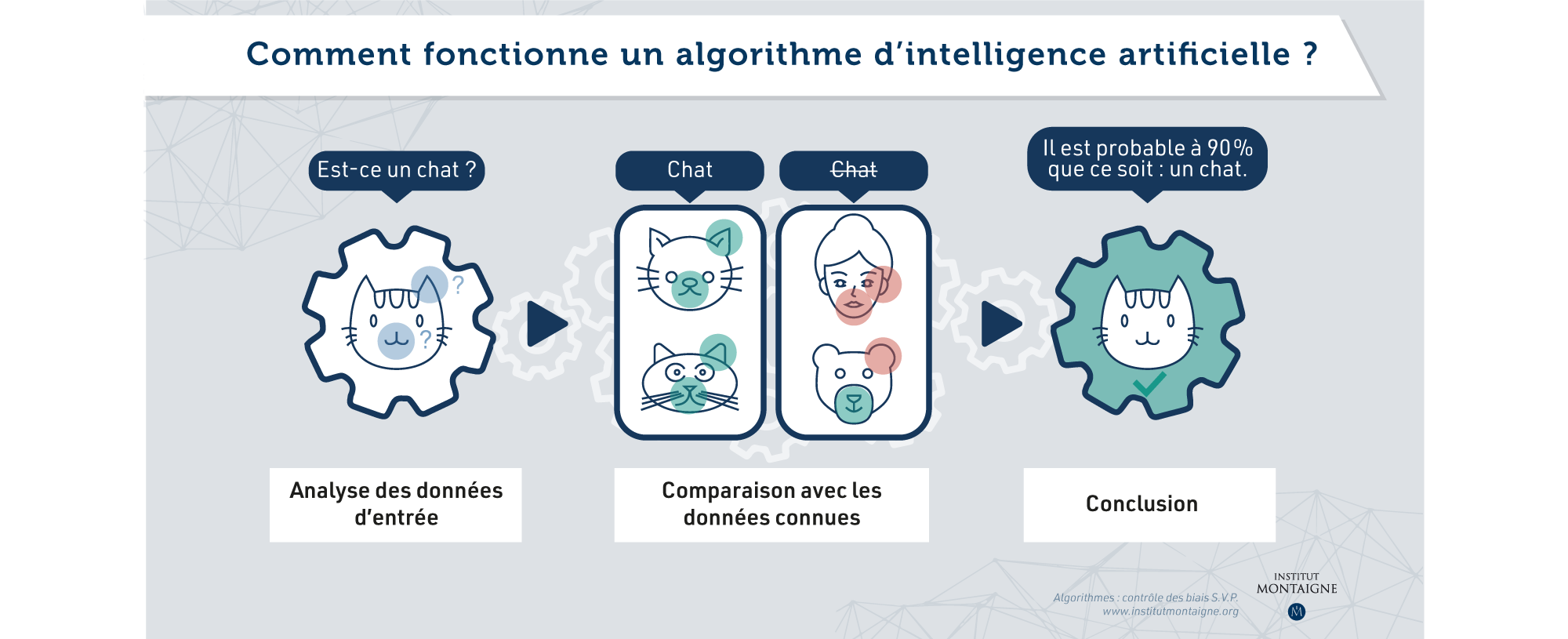

Les algorithmes de machine learning apprennent seuls, c’est à dire qu’ils créent eux-même les liens pour arriver à une conclusion. Si on leur demande de reconnaître un chat sur une image, ils formuleront une solution de type : « étant donné qu’il y a des oreilles pointues sur l’image, je suis sûr à 90 % qu’il s’agit d’un chat« .

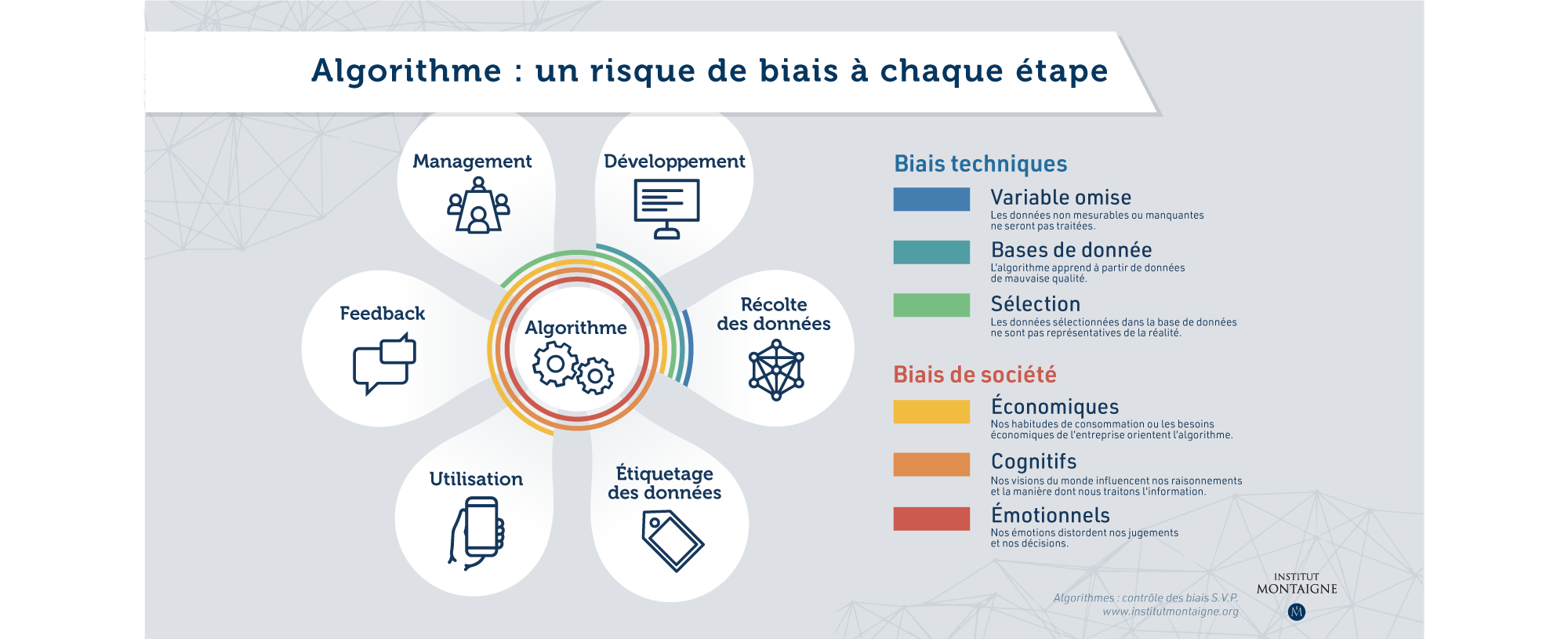

Pourquoi peuvent-ils être biaisés ?

Le biais d’un algorithme est l’écart entre ce que dit l’algorithme et la réalité. Ils sont très souvent dûs aux données utilisées. Si dans la zone où l’algorithme est développé les photos de chats sont toujours prises sur tapis, mais pas les chiens, l’algorithme considérera qu’un tapis en arrière-plan est signe de présence d’un chat. Si on l’utilise dans une autre zone, où des chiens sont également pris en photo sur des tapis, l’algorithme pourrait reproduire ce biais, et croire reconnaître un chat.

Amplifier ou réduire les discriminations ?

Pourquoi peuvent-il discriminer ?

Dans certains cas, ces biais peuvent entraîner des discriminations. C’est-à-dire que l’algorithme aboutit à des propositions différentes selon, entre autres, que la personne soit d’un genre ou d’une origine ethnique spécifique.

Prenons un algorithme de recrutement dont l’objectif est d’identifier les meilleurs profils pour un métier donné. Une façon de procéder est de regarder, aujourd’hui, quelles sont les caractéristiques des personnes qui exercent ce métier. Si ce métier est fait à 90 % par des hommes, l’algorithme pourrait conclure que le critère « femme » n’est pas approprié pour ce métier. En conséquence, il pourrait proposer moins de candidates au recruteur.

Des algorithmes pour réduire les discriminations

Le combat des biais algorithmiques, c’est donc avant tout un combat contre des biais déjà existants au quotidien. Les algorithmes, malgré le risque parfois avéré de biais, sont également un progrès en matière de discrimination à bien des égards puisqu’ils peuvent objectiver des décisions humaines parfois biaisées. L’enjeu n’est pas seulement de produire des algorithmes équitables mais bien de réduire les discriminations dans la société. Ainsi, après avoir pris connaissance d’un biais dans la société, nous pourrions demander à un algorithme de nous aider à le corriger.

Créer des algorithmes équitables

Équité individuelle ou équité de groupe ?

La difficulté est donc de créer des algorithmes équitables. Mais premièrement, l’équité, ce n’est pas si simple que ça : s’agit-il de juger tout le monde sur les même critères (équité individuelle) ? Ou bien s’agit-il de s’assurer qu’aucun groupe (homme, femme, origine ethnique, etc.) n’est discriminé ? Malheureusement les deux sont mathématiquement incompatibles, c’est à dire qu’on ne peut avoir une totale équité de groupe et une totale équité individuelle.

En effet, l’équité peut être conçue de deux façons différentes :

- l’équité individuelle,

qui assure que des individus aux profils proches seront traités de la

même façon, c’est-à-dire qui prend en compte les caractéristiques de

l’individu pour adapter une décision.

- l’équité de groupe, qui assure que le processus de décision ne favorise pas arbitrairement un certain groupe, c’est-à-dire qui prend en compte l’appartenance de l’individu à un groupe pour adapter une décision.

Pouvoir mesurer les biais des algorithmes

Deuxièmement, il faut pouvoir mesurer les biais. Cela nécessite de connaître les caractéristiques contre lesquelles on veut empêcher une discrimination. Par exemple, pour savoir si un algorithme publicitaire discrimine les femmes, il faut que je sache à combien de femmes l’algorithme a distribué des publicités. Dans certains cas, comme l’origine ethnique, l’utilisation de ces données est protégée – et à juste titre. Cependant, sans l’accès à ces données, nous ne pouvons pas savoir s’il y a une discrimination.

Les enjeux pour les algorithmes

L’enjeu de la performance

Si corriger un algorithme pour le rendre équitable est une priorité, cela représente aussi un enjeu pour sa performance. Il sera donc difficile et coûteux pour de nombreux acteurs de lutter contre ces discriminations algorithmiques.

L’enjeu de l’innovation

Lutter contre les biais des algorithmes, c’est aussi réaliser une synthèse entre la protection des citoyens contre les discriminations et le soutien à l’innovation et à l’économie numérique. Restreindre fortement l’usage des algorithmes, c’est déclasser l’industrie française du numérique et subir une domination technologique américaine et chinoise. Mais laisser faire, c’est ignorer le potentiel de destruction de telles innovations sur notre tissu social.

Découvrir le rapport sur le site de l’Institut Montaigne : Algorithmes : contrôle des biais S.V.P.